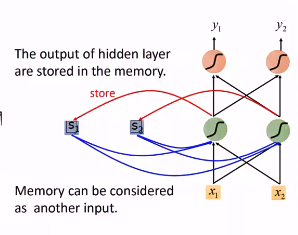

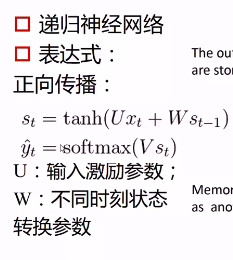

递归神经网络

中间层激励保存??

下一刻重新输入

记忆功能???

第一个输入得到第一个输出,存储中间量,

之前的输出和新的输入,产生新的中间层,

工作过程

文本处理(训练)

一个神经元,不同时刻

每个时刻都有输出

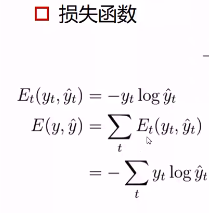

损失函数

反向计算和传统神经网络相同

作用

语言

文本信息处理

多层是神经网络,双向网络

梯度问题

梯度>1容易察觉

梯度<1难以发现,梯度消失

解决方法:

非线性激励

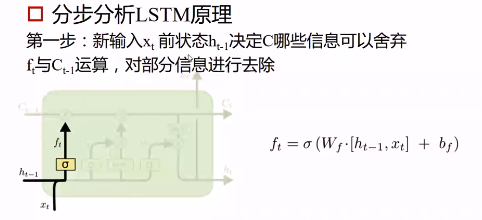

LSTM长短记忆单元

Gate

保存重要记忆

LSTM

Peephole connection

生成单词之间的条件概率

Gate忘记/更新

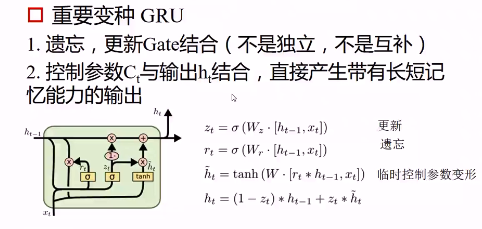

GRU

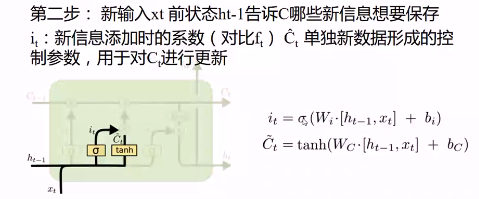

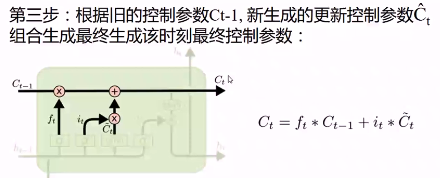

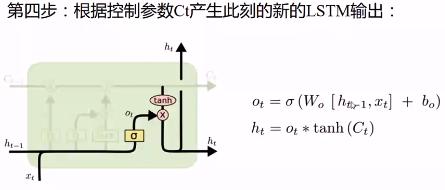

lSTM工作方式

Word2Vec

语言处理特征提取

1.建立字典,没个词生成一个one-hot向量

2.训练数据集构建

3.简单神经网络(中见词语:不同词之间的相互关系)

保存中间层

4.生成最终的Vect

特点:

利用上下文进行学习

两个词上下文类似,生成的vector会接近

具有类比特性:king-queen+female=male

字符->数据