DeepFace:结构化图片的特殊处理(facebook研究出来的)

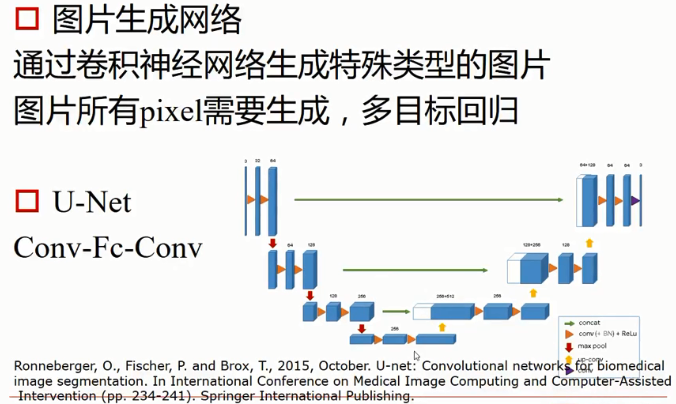

U-net:图片生成网络

AlexNet

HOG,LBP提取特征

pooling 每一张都要单独寻找最大值

全连接层

分类问题主要用softmax

回归问题主要用sigmoid

其他用relu

参数计算

卷积神经网络的基本构成:卷积层+池化层+全连接层

卷积神经网络的基本构成:卷积层+池化层+全连接层

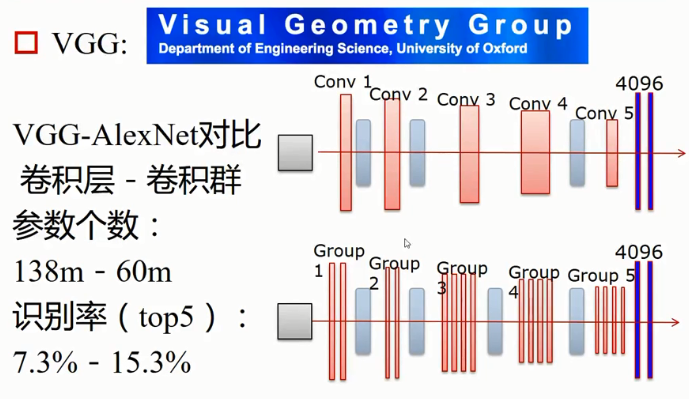

VGG

AlexNet增强版

vgg基本上卷积核用3*3,pad 1,

vgg基本上卷积核用3*3,pad 1,

参数变化:最后一个卷积层和去全连接层包含几乎全部的参数,将不同位置

的信息关联起来

VGG参数

VGG的作用

VGG结构简单:同AlexNet结构相似

性能优异,同AlexNet相比性能提升明显,同GoogleNet,ResNet相比,表现接近,

选择最多的基本模型:方便进行结构的优化,设计,SSD,RCNN等其他任务的基本模型

比较低层的layer可以不update,因为主要提取的是结构,边界信息等等

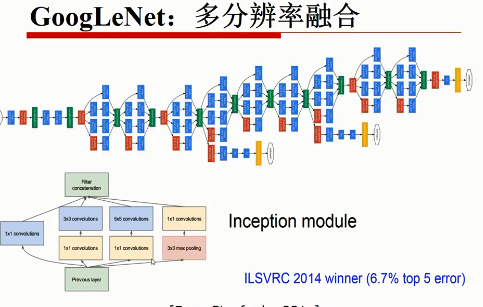

GoogleNet:多分辨率融合

Inception module

Inception结构问题:

分辨率的问题,尺度的不匹配性(不同大小的卷积核来解决这个问题)->导致参数暴增

1*1的卷积核是为了减少参数

全卷积结构FCN

没有全连接层

输入图片大小没有限制(只有卷积)对比CNN

空间信息有丢失(没有全连接层)

参数更少,表达力更强

ResNet:机器识别超过人类

AlexNet 8层

VGG 19层

ResNet 152层

ResNet的优势

前向计算:低层卷积网络高层卷积网络信息融合;层数越深,模型的表现力越强

反向计算:导数传递更直接,越过模型,直达各层

ResNet结构特性

针对图片大小不同可以进行预处理,处理成为大小一样的

空间信息:图片中空间位置信息

DeepFace:结构化图片的特殊处理

人脸识别:通过观察人脸确定对方身份,在应用中更多的是确认(verification)

Frontalization:图片的对齐

人脸识别数据特点:

结构化:所有人脸,组成相似,理论上能够实现对齐

差异化:相同位置,形貌不同

一般神经网络处理人脸是别的问题:

不同局部特性对参数影响相互削弱

解决方法:不同区域,不同参数

人脸对准

局部卷积

每个卷积核固定某一区域不移动,

不同区域之间不共享卷积核

卷积核参数由固定区域数据确定

最后一层做了SVM处理

全局部卷积连接的缺陷

1.预处理:大量对准,对对准要求高,原始信息可能丢失(现在已经有了自适应的解决方案dlb)

2.卷积参数数量很大,模型收敛难度大,需要大量数据

3.模型可扩展性差,基本限于人脸计算

U-Net:图片生成网络

反池化

原来进行池化的时候,记住位置,反池化的时候,还放回原来的位置,对于空白的,可能会直接补充0

逆卷积(Deconvolution)

参数训练可以得到

是否生成原图,看需求